Acest videoclip care pretinde că arată atacuri asupra Tel Avivului a fost generat de inteligența artificială

- Publicat pe 6 Martie 2026, la 10:04

- Actualizat pe 7 Aprilie 2026, la 17:20

- 6 minute de citit

- De: Pierre MOUTOT, AFP Franța

- Traducerea și adaptarea AFP România

Atacurile aeriene masive israeliano-americane care au vizat Iranul la sfârșitul lunii februarie 2026 au declanșat un război regional în Orientul Mijlociu, țara vizată ripostând prin lansarea de rachete asupra Israelului, dar și asupra statelor din Golf care găzduiesc baze americane. În acest context, un videoclip viral care pretinde că ar arăta o serie de lovituri cu rachete asupra orașului israelian Tel Aviv a adunat milioane de vizualizări online. În realitate însă, clipul a fost generat cu ajutorul inteligenței artificiale, iar evenimentul pe care pretinde că îl arată nu a avut loc.

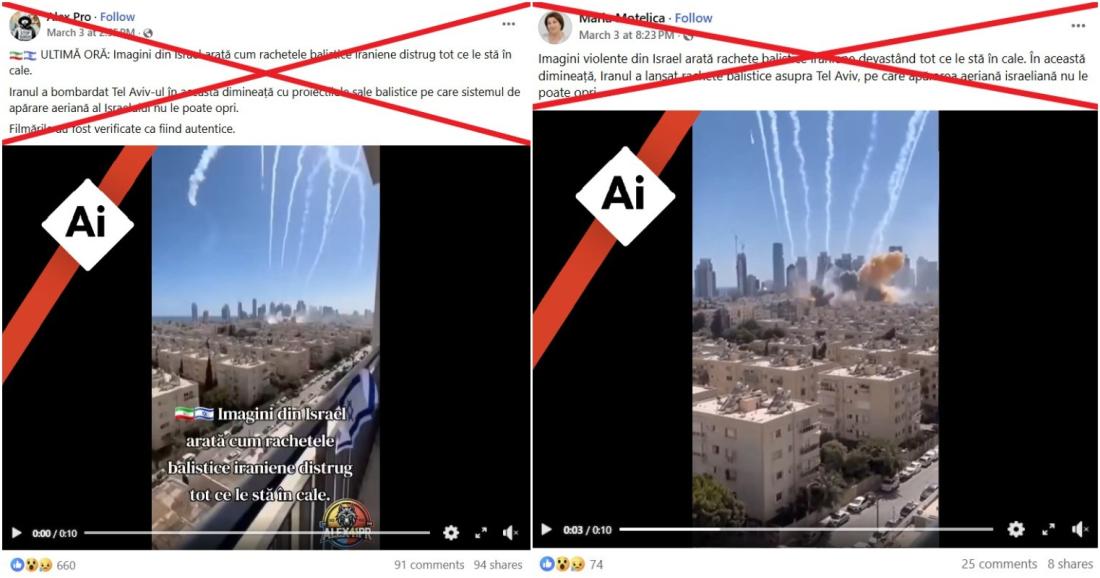

„ULTIMĂ ORĂ: Imagini din Israel arată cum rachetele balistice iraniene distrug tot ce le stă în cale. Iranul a bombardat Tel Aviv-ul în această dimineață cu proiectilele sale balistice pe care sistemul de apărare aeriană al Israelului nu le poate opri. Filmările au fost verificate ca fiind autentice”, spune descrierea unei postări pe Facebook din 3 martie 2026, distribuită de aproape 100 de ori de atunci. Postarea include un videoclip în care aproximativ o duzină de rachete cad printre clădiri într-o zonă urbană densă, ridicând coloane neobișnuite de fum.

„Imagini violente din Israel arată rachete balistice iraniene devastând tot ce le stă în cale. În această dimineață, Iranul a lansat rachete balistice asupra Tel Aviv, pe care apărarea aeriană israeliană nu le poate opri”, spune o postare similară care distribuie același videoclip.

Videoclipul a fost distribuit cu afirmații similare în multe alte limbi, inclusiv în arabă, engleză, franceză și germană, adunând sute de mii de aprecieri și distribuiri.

În realitate însă, videoclipul prezintă semne caracteristice ale conținutului creat cu ajutorul inteligenței artificiale (AI), iar loviturile care apar în imagini nu corespund niciunui eveniment raportat până în prezent.

Semne tipice unui videoclip generat cu AI

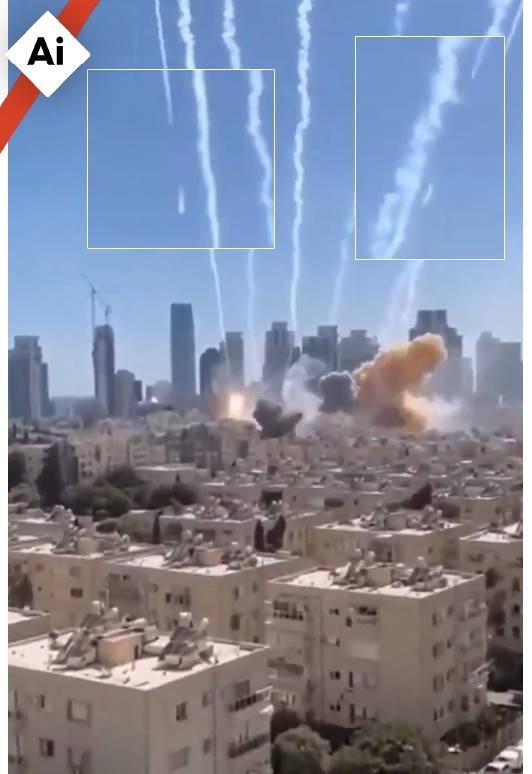

În primul rând, videoclipul conține mai multe inconsecvențe vizuale tipice conținutului generat cu AI.

Este realizat astfel încât să pară filmat cu un smartphone, cu un zoom la începutul clipului către zona unde lovesc rachetele. În timpul zoomului și al revenirii la cadru larg, mașinile capătă forme ciudate: unele par lipite între ele, altele sunt doar parțial conturate sau deformate în mod neobișnuit.

Analizând clădirile din fundal, printre panourile solare care acoperă fiecare acoperiș într-un mod suspect de uniform, pot fi observate și alte distorsiuni și anomalii vizuale.

Urmele de fum lăsate de rachete se opresc brusc în anumite locuri.

În cele din urmă, două macarale-turn apar în cadru doar în momentul zoomului către zona impactului.

AFP a publicat mai multe ghiduri, inclusiv aici și aici, pentru a ajuta publicul să identifice conținutul sintetic.

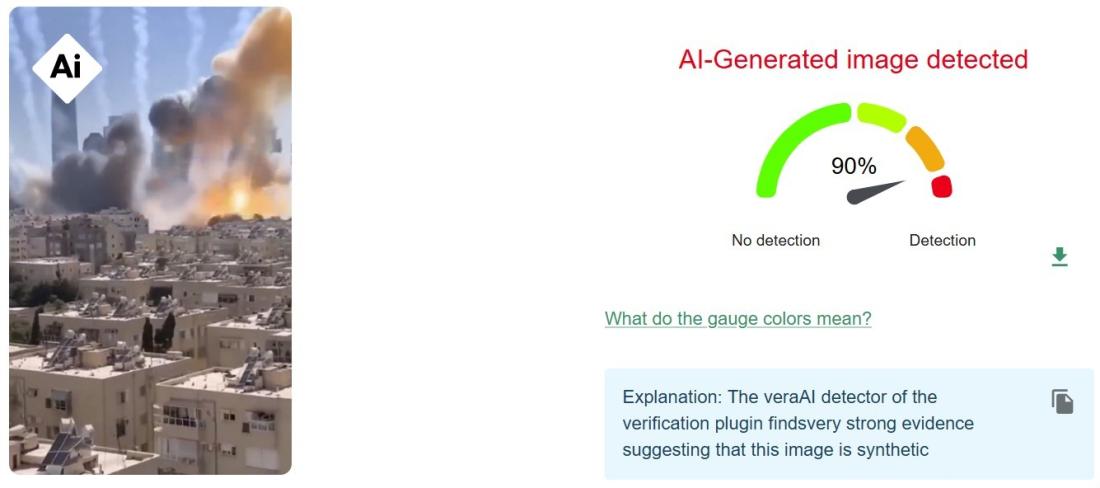

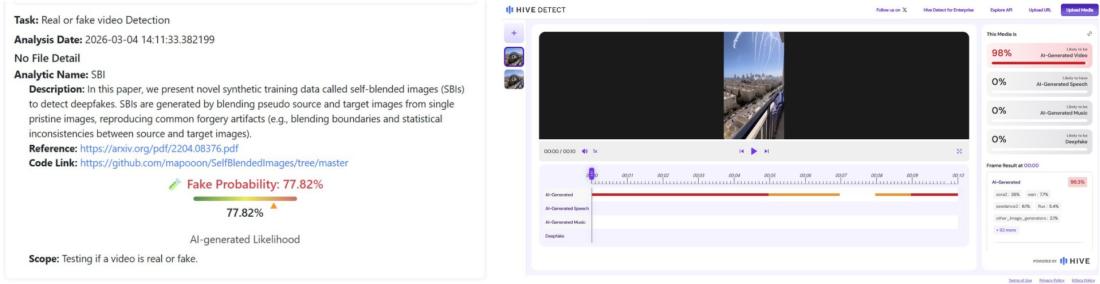

Analize suplimentare realizate cu instrumente de detectare a conținutului sintetic au indicat scoruri ridicate, sugerând că videoclipul a fost probabil generat cu ajutorul unor instrumente bazate pe inteligență artificială. Verificările efectuate pe cadre din videoclip cu ajutorul instrumentului de verificare InVid-Weverify — dezvoltat în colaborare cu AFP — au concluzionat că imaginile prezintă o probabilitate ridicată de a fi fost create cu AI.

Testele realizate cu modelul DeepFake-O-Meter pentru detectarea compozițiilor de imagini sintetice, dezvoltat de Media Forensics Lab de la University at Buffalo, precum și analiza videoclipului pe platforma Hive Moderation, au indicat de asemenea o probabilitate ridicată ca acesta să fi fost generat cu AI.

În plus, o serie de alte indicii arată că videoclipul nu este autentic.

Videoclipul nu corespunde niciunui eveniment real

Căutările inverse de imagini și căutările după cuvinte-cheie arată că niciun media local sau național din Israel nu a relatat despre astfel de imagini, așa cum s-a întâmplat în cazul altor lovituri cu rachete care au vizat orașul în zilele ce au urmat izbucnirii războiului. Nici corespondenții AFP aflați la fața locului nu au fost martori la această presupusă lovitură.

De asemenea, nu există online sau pe rețelele sociale alte videoclipuri care să arate incidentul, în ciuda caracterului său distinctiv, marcat de cele 15 dâre de fum lăsate de presupusele lansări de rachete.

Sunetul sirenelor de raid aerian nu poate fi auzit nici în videoclip, spre deosebire de imaginile filmate în timpul altor atacuri care au lovit Israelul.

Tel Avivul a fost într-adevăr vizat de mai multe ori de atacuri cu rachete, fiind lovit de Iran și de aliatul său, miliția șiită libaneză Hezbollah. Cu toate acestea, verificările realizate de AFP nu au identificat nicio dovadă a unei lovituri de o asemenea amploare în centrul orașului israelian, care ar fi provocat numeroase victime și răniți.

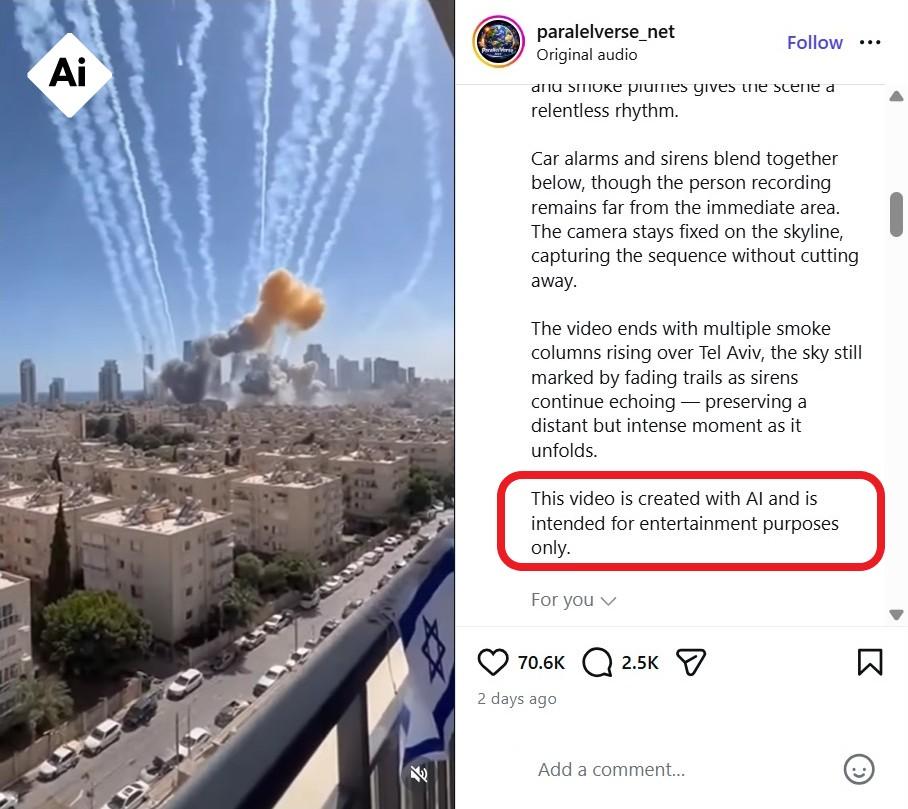

Căutarea inversă a imaginilor a dus și la cea mai veche versiune a clipului pe care AFP a reușit să o identifice, publicată pe 2 martie 2026 pe un cont de Instagram care pare să fi distribuit și alte videoclipuri generate cu AI.

Postarea include un avertisment care precizează că videoclipul a fost „creat cu AI și este destinat doar în scopuri de divertisment”. Descrierea care însoțește postarea prezintă o scenă fictivă detaliată despre lovituri cu rachete asupra Tel Avivului, sugerând că imaginile au fost concepute ca un conținut sintetic, nu pentru a documenta un eveniment real. Textul descrierii pare redactat într-un mod care amintește de un „prompt”, adică un tip de instrucțiune textuală pe care un utilizator o introduce într-un generator AI pentru a crea conținut foto sau video.

Chatboți AI au amplificat informația falsă

Răspândirea videoclipului a fost facilitată și de răspunsuri incorecte oferite la întrebările utilizatorilor pe anumite platforme, care susțineau că secvența este autentică și verificată. Întrebat despre autenticitatea videoclipului, agentul conversațional AI al platformei X, Grok, a răspuns în mod repetat că „videoclipul este real”.

Nu este prima dată când chatbotul face astfel de greșeli. S-a întâmplat și în trecut, inclusiv în legătură cu alte subiecte sensibile, precum conflictul dintre India și Pakistan sau protestele anti-imigrație din Statele Unite.

În a șaptea zi a războiului declanșat pe 28 februarie de bombardamentele masive asupra Iranului, conflictul continuă să se extindă — în largul coastelor Sri Lankăi, în apropierea spațiului aerian turc și în zonele kurde din Irak — în timp ce schimburile de focuri și rachete între părțile beligerante continuă.

Acest război regional a generat deja o cantitate mare de dezinformare. AFP Fact Check a verificat deja mai multe imagini și videoclipuri de la începutul ofensivei israeliano-americane împotriva Iranului, care pot fi consultate aici.

Acest articol a fost actualizat pentru a completa metadatele.7 aprilie 2026 Acest articol a fost actualizat pentru a completa metadatele.

Copyright © AFP 2017-2026. Orice utilizare comercială a acestui conținut necesită un abonament. Faceți clic aici pentru a afla mai multe informații.

Există un conținut pe care ai vrea ca AFP să îl verifice?

Contactează-ne